DeepSeek又刷屏了。

这次不是因为某个新功能,而是因为它的 MoE(混合专家)架构 被证实可以用 1/10的成本 做出接近GPT-4水平的模型。

作为一个既写代码又学法学的跨界程序员,我觉得这件事值得好好聊聊。

不是因为技术有多炫酷,而是因为它可能改变整个AI行业的游戏规则。

一、什么是MoE?用大白话解释

MoE全称是 Mixture of Experts,中文叫"混合专家模型"。

这个名字听起来很学术,其实概念很简单:

不是让一个"超级大脑"处理所有问题,而是让一群"专家"各司其职,按需调用。

传统模型 vs MoE模型

| 对比项 | 传统模型(如GPT-4) | MoE模型(如DeepSeek) |

|---|---|---|

| 架构 | 一个巨大的神经网络 | 多个小专家网络 + 门控网络 |

| 参数 | 全部激活 | 每次只激活部分专家 |

| 计算成本 | 高 | 低(约1/10) |

| 训练成本 | 极高 | 显著降低 |

一个类比

想象你要开一家餐厅:

- 传统模型:雇一个全能厨师,什么菜都会做,但工资很高

- MoE模型:雇一群专科厨师(川菜师傅、粤菜师傅、面点师傅……),来了什么客人就派什么师傅,成本低效率高

MoE的核心思想就是:让专业的人做专业的事。

二、DeepSeek的MoE有什么特别之处?

MoE不是DeepSeek发明的,但DeepSeek把它做到了极致。

1. 专家数量更多

- 一般MoE模型:8-64个专家

- DeepSeek-V2:64个专家,每次激活6个

- DeepSeek-V3:256个专家,每次激活8个

专家越多,分工越细,效率越高。

2. 门控网络更智能

门控网络(Gating Network)是决定"调用哪个专家"的调度器。

DeepSeek的创新在于:

- 门控网络本身也是学习的,不是硬编码的规则

- 能根据输入动态选择最合适的专家组合

- 支持"专家并行",多个专家同时工作

3. 负载均衡优化

MoE的一个经典问题是:某些专家会被过度使用,其他专家闲置("专家崩溃")。

DeepSeek通过辅助损失函数和专家容量限制解决了这个问题,让每个专家都能被充分利用。

三、为什么MoE能降低成本?

这是很多人关心的问题:为什么MoE能用1/10的成本做到同样的效果?

1. 训练阶段:参数共享

传统模型:1万亿参数,全部需要训练

MoE模型:

- 总参数1万亿

- 但每次只激活100亿参数

- 实际训练成本 ≈ 100亿参数模型的成本

相当于用100亿参数的预算,训练出1万亿参数的能力。

2. 推理阶段:按需计算

传统模型:每次推理都要过一遍全部参数

MoE模型:

- 输入一个问题

- 门控网络判断:这个问题需要哪些专家

- 只激活相关专家,其他专家"睡觉"

计算量大幅降低,响应速度更快。

3. 硬件利用率更高

MoE的稀疏激活特性,让GPU的利用率大幅提升。

传统模型:GPU经常"吃不饱"

MoE模型:专家并行,GPU满负荷运转

四、MoE的局限性(理性看待)

虽然MoE很牛,但也不是万能的。

1. 内存占用大

虽然计算时只激活部分专家,但所有专家都要加载到内存里。

- 1万亿参数的MoE模型,内存占用还是1万亿级别

- 对部署硬件要求很高

2. 专家崩溃风险

虽然DeepSeek优化了负载均衡,但专家崩溃的风险依然存在。

如果门控网络"偏心",某些专家会被过度使用,导致:

- 这些专家过拟合

- 其他专家学不到东西

- 整体性能下降

3. 调试难度大

MoE的内部机制比传统模型复杂得多:

- 专家之间的交互难以解释

- 门控网络的决策逻辑不透明

- 出了问题很难定位

对于需要可解释性的场景(如医疗、法律),MoE可能不是最佳选择。

五、对程序员的启示

作为一个程序员,我从DeepSeek的MoE架构中学到了什么?

1. 架构设计的重要性

DeepSeek的成功证明:好的架构设计,比堆参数更重要。

这和我们写代码一样:

- 烂代码:堆逻辑,越写越乱

- 好代码:设计好架构,清晰可扩展

2. 专业化分工的价值

MoE的核心思想是"专业分工"。

这在软件开发中同样适用:

- 微服务架构:不同服务负责不同功能

- 团队分工:前端、后端、算法、测试各司其职

- 代码模块化:每个模块只做一件事

让专业的人做专业的事,效率最高。

3. 资源优化的思路

MoE的"按需激活"思路,可以应用到很多场景:

- 微服务的弹性伸缩

- 云资源的按需分配

- 代码的懒加载

不要一开始就加载全部资源,按需分配才是最优解。

说到这儿,分享一个我在python-office中实际应用的例子。

在重构项目时,我采用了"懒加载"(Lazy Loading)的策略:

1 | # 原来的做法:启动时就加载所有模块 |

这个简单的改变,让库的启动时间从3秒降到了0.5秒。

原理和MoE一样:不是把所有专家都叫醒,而是谁来问诊才叫哪个专家。

这个思路可以应用到很多场景:

- 网站的首屏加载:先加载可见区域,其他内容懒加载

- App的启动优化:核心功能先加载,次要功能延迟加载

- 数据库连接池:按需创建连接,而不是一开始就创建一堆

资源优化的核心原则:按需分配,避免浪费。

六、写在最后

DeepSeek的MoE架构,让我看到了国产AI的希望。

不是因为它"超越OpenAI",而是因为它证明了:在资源有限的情况下,通过架构创新,依然可以做到世界一流。

这对于创业公司、中小团队、个人开发者,都是一个巨大的鼓舞。

你不需要有OpenAI的算力,也可以做出有用的AI产品。

AI是杠杆,不是对手。

关键是:找到适合你的架构,发挥你的优势。

选择权在你手里。

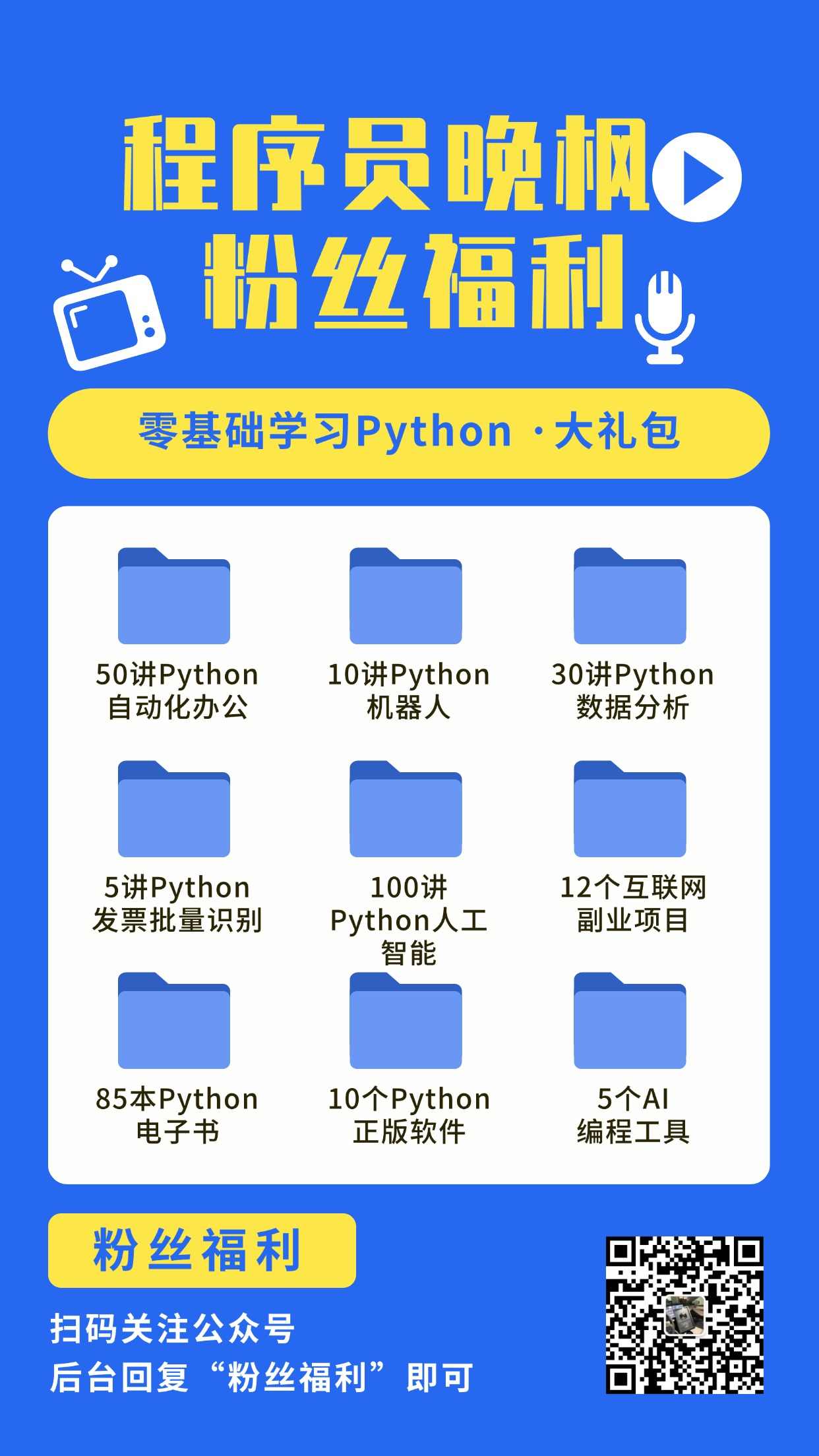

🎁 福利时间

想深入了解MoE架构的实现细节?送你一份我整理的《MoE架构技术资料包》:

- DeepSeek技术报告解读

- MoE论文合集(附中文摘要)

- PyTorch实现代码示例

👉 点击免费领取

📚 想系统学习AI编程?

《30讲 · AI编程训练营》 —— 从0到1掌握AI编程实战。

另外,大家去给小明的小红书👇账号点点赞吧~!

🧧 领个红包再走呗~

程序员晚枫,专注AI编程培训,法律硕士转行的Python程序员,开源项目 python-office 作者。